2025年最新推理大模型API參數與性能詳解:通義千問Max、豆包1.5 Pro、混元Lite深度對比

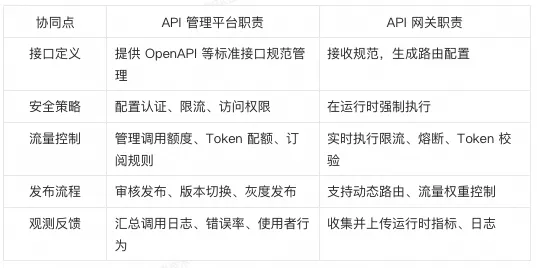

在現實系統中,API 網關與 API 管理從來不是“二選一”的問題,而是“雙劍合璧”的組合。一個負責流量的運行時調度與保護,一個負責 API 的生產、發布與運營。只有將兩者協同配合,才能構建出一個既高效又可持續運營的 API 基礎設施。

在平臺化架構中,API 的生命周期可以抽象為三層職責:

這三層中,API 管理平臺主導生產與發布,而 API 網關控制運行時訪問,二者通過接口注冊、服務發現、策略下發等機制協同工作。

例如:

/v2/user/info,并設定了使用者必須綁定 API Key;這就形成了從設計 → 發布 → 調用 → 回流反饋的閉環。

具體來說,兩者協同主要體現在以下幾方面:

這種協同在現代 API 工具鏈中已經非常成熟,無論是開源還是商業方案:

這些方案共同體現出一個趨勢:越成熟的平臺,越注重 API 管理與網關的整合度與自動化程度。

隨著應用走向大模型范式,API 的角色正在發生根本性變化。從“訪問一個后端服務的接口”變成“通過大模型調用 MCP Server”。這一轉變帶來了新的挑戰,推動著 API 網關與 API 管理進入全新的階段,即 AI 網關和 MCP Server 管理。

AI 網關:

從容器和微服務入口躍遷到模型和 MCP 入口

在容器和微服務的架構下,API 網關負責接入控制、服務發現、協議轉換和安全策略。但大模型時代,重新定義了“流量”與“服務”的內涵,API 網關也完成了從微服務入口到模型入口的躍遷。

大模型應用中,流量不再是短平快的 HTTP 請求,而是長連接、語義化、高成本、狀態復雜的推理請求。這類請求具有以下新特征:

這些特征都遠超傳統 API 網關的職責范疇,也推動了 AI 網關形態的誕生。

AI 網關可以被視為「大模型接口的基礎設施」,在保留傳統網關核心職責的基礎上,做了以下兩層能力的擴展:

可以說,AI 網關的誕生,標志著“流量”的語義發生了改變:它不再只是請求字節的載體,而是承載了語義理解、Token 分發、成本調度與智能決策的復雜能力,成為企業構建智能應用的基礎入口。

在傳統應用中,API 是確定性的輸入輸出接口,供消費者調用;而在大模型應用中,調用方變成了大模型,被調用方變成了 MCP Server,因此,傳統 API 管理平臺(基于 Swagger 規范進行設計 → 開發 → 測試 → 發布 → 監控 → 迭代)已無法契合 MCP 規范。

正如早期 REST API 的爆發催生了 Postman、Apifox 等 API 管理工具,MCP 的繁榮也將催生了 MCP Server(AI 原生的 API)管理,這一全新的訴求。

參考 API 管理,它可能需要具備以下能力:

回顧整個接口技術的發展,我們可以看到一個清晰的“雙軌演進”軌跡:API 網關負責流量的全生命周期管理,API 管理則面向 API 的全生命周期管理,兩者天然協作。

在微服務時代,一個負責守好入口,一個負責編排出口;大模型時代,它們正逐步共同支撐起模型服務化、調用平臺化、治理自動化的新范式。未來,API 不只是連接,更是智能應用的載體;API 網關和 API 管理,共同構建了現代企業對內對外開放能力的基石。

文章轉載自:Agent 工程師繞不開的必修課:API 網關 vs API 管理

2025年最新推理大模型API參數與性能詳解:通義千問Max、豆包1.5 Pro、混元Lite深度對比

2025年五大AI大模型API基礎參數、核心性能:Gemini 2.5、DeepSeek R1、Claude 3.7

2025年五大AI大模型API價格對比:Gemini 2.5、DeepSeek R1、Claude 3.7

國產精品大模型API價格對比:通義千問 Max、字節跳動Doubao 1.5 pro 256k、DeepSeek V3

大模型API亂斗,基礎參數、核心性能:Grok3、deepseek R1、ChatGPT 4o

3大AI語言大模型API價格的區別:ChatGPT 4o、百度千帆 ERNIE 4.0、阿里通義千問 Max

從頭開始構建 GPT 風格的 LLM 分類器

3大AI語言大模型API基礎參數、核心性能的區別:ChatGPT 4o、百度千帆 ERNIE 4.0、阿里通義千問 Max

大模型API亂斗,價格對比:Grok3、deepseek R1、ChatGPT 4o