哈佛 Translation Company 推薦:如何選擇最佳翻譯服務

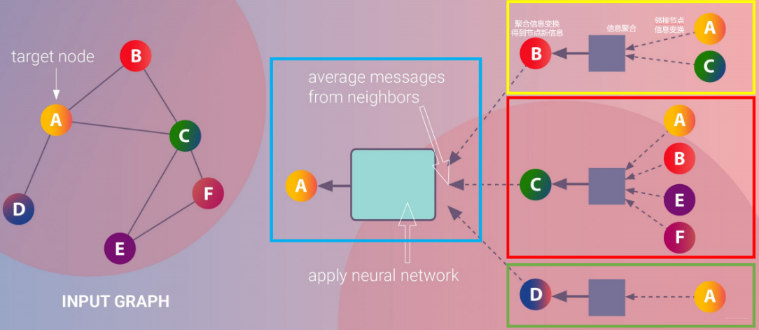

消息傳遞框架一般包括三個核心步驟:

這種范式的優點在于它的通用性和可擴展性,幾乎可以應用于任何類型的圖結構,尤其是在復雜的網絡中,其效率和準確性都表現得尤為突出。

MessagePassing基類的功能MessagePassing是Pytorch Geometric庫中一個關鍵的基類,提供了構建基于消息傳遞的圖神經網絡的便利。通過繼承這個基類,開發者可以輕松實現自定義的GNN模型。該基類封裝了消息傳遞的基本流程,并允許用戶定義消息的生成和更新方式。

在實現一個圖神經網絡時,開發者需要重寫三個關鍵方法:message()、aggregate()和update()。這些方法分別用于定義消息的生成、聚合以及節點信息的更新。

import torch

from torch_geometric.nn import MessagePassing

class CustomGNN(MessagePassing):

def __init__(self, in_channels, out_channels):

super(CustomGNN, self).__init__(aggr='add')

self.lin = torch.nn.Linear(in_channels, out_channels)

def forward(self, x, edge_index):

x = self.lin(x)

return self.propagate(edge_index, x=x)

def message(self, x_j):

return x_j

def update(self, aggr_out):

return aggr_out利用MessagePassing基類,我們可以輕松實現二相圖的消息傳遞。二相圖中的節點可以分成兩類,消息傳遞時只在這兩類節點之間進行,而不會在同類節點之間傳遞信息。

在二相圖中,消息傳遞的聚合步驟只涉及不同類的節點。這意味著我們可以在聚合時利用二相圖的結構特點,減少不必要的計算,提高效率。

class BipartiteGNN(MessagePassing):

def __init__(self, in_channels, out_channels):

super(BipartiteGNN, self).__init__(aggr='add')

self.lin = torch.nn.Linear(in_channels, out_channels)

def forward(self, x, edge_index):

x = self.lin(x)

return self.propagate(edge_index, x=x)

def message(self, x_j):

return x_j

def update(self, aggr_out):

return aggr_out消息傳遞的數學表述通常用來描述節點信息在圖中的傳播過程。假設節點$i$的表示為$x_i^{(k)}$,那么經過$k$次消息傳遞后,節點$i$的表示更新為:

$$x_i^{(k+1)} = ext{AGGREGATE}( ext{MESSAGE}(xj^{(k)}, e{ij}))$$

其中,$ ext{MESSAGE}$函數用于生成消息,$ ext{AGGREGATE}$函數用于聚合消息。消息傳遞的核心在于通過圖中的鄰接關系,不斷更新節點的表示。

在圖神經網絡的實現中,自環是一個常見的技巧。通過在鄰接矩陣中添加自環,節點的信息可以在消息傳遞過程中保留其原始特征,從而增強模型的表達能力。

自環的實現可以通過torch_geometric.utils.add_self_loops函數實現,該函數會自動在鄰接矩陣中添加自環。

什么是GNN中的消息傳遞?

為什么二相圖在GNN中重要?

如何在GNN中實現自環?

torch_geometric.utils.add_self_loops函數實現,以增強節點的特征表達能力。MessagePassing基類的作用是什么?

MessagePassing基類提供了構建GNN的基本框架,用戶可以通過繼承該類實現自定義的消息傳遞邏輯。在GNN中如何定義消息和聚合邏輯?

MessagePassing的子類中重寫message()和aggregate()方法,以定義消息生成和聚合的具體邏輯。通過本文的介紹,我們可以看到,消息傳遞框架在GNN中扮演著至關重要的角色。而二相圖的應用則為GNN的效率提升提供了有效的解決方案。無論是在理論研究還是實際應用中,理解和掌握這些概念對于成功應用GNN至關重要。